DEEPFAKE - UNA ESTAFA MUY SURREAL

“Aquellos que no quieren imitar nada, no producen nada.”

Las fake news no son nada nuevo, pero ahora tienen un aspecto distinto.

Es difícil pensar en los usos morales de una tecnología construida para engañar.

La tecnología deepfake es la forma de manipulación de los medios más surrealista que hemos visto hasta la fecha, una que amenaza la confianza que tenemos en nuestra propia percepción.

Cuando tenemos una razón para dudar de nuestros propios sentidos, la verificación se convierte en algo casi imposible.

La ausencia de confianza puede ser igual de dañina que la confianza mal puesta, haciendo que una sociedad polarizada tenga que decidir sobre cuál es cual.

La era de la información llevó a la guerra psicológica dentro de nuestras casas. Desinformación, o siquiera la mera posibilidad de ella, causa que ahora haya que pelear para filtrar la verdad de las mentiras y de la publicidad.

Una de las últimas estafas subrayó esta creciente cuestión acerca de la confianza digital y la identidad.

DeTrade Fund se presentó como un proyecto manejado por la comunidad que ofrece a los usuarios el acceso a sus bots de arbitraje CEX, siempre y cuando a los usuarios les pertenecieran suficientes de sus tokens nativos DTF.

DTF fue vendido en una venta privada que generó 1,438 ETH antes de que la empresa desapareciera con los fondos.

Para generar la confianza de sus usuarios, esta estafa se enfocó en crear una identidad falsa que tenía una presencia tanto online como offline. Registraron una empresa con Companies House y agendaron comunicados de prensa en varias plataformas en las cuales enseñaron repetitivamente la cara y nombre de su CEO “Mark Jensen”.

En un mercado lleno de proyectos anónimos y exclusivamente online, DeTrade resaltó con su identidad del “mundo real”. El estafador capitalizó la confianza que ponemos en el rostro humano.

Después de que los usuarios se enteraron de que la venta privada les había vendido nada más que mentiras, la atención se volteó a los videos promocionales que DeTrade había publicado en las redes sociales.

Un comportamiento poco usual por el supuesto CEO de DeTrade atrajo la atención cuando un usuario sugirió que era, de hecho, generado por IA.

El hilo de Twitter entero se encuentra aquí.

rekt habló con un experto de la industria (EI) para conocer su opinión.

EI:

Mi nombre es ELIMINADO, soy el CEO de ELIMINADO. Nosotros desarrollamos tecnologías basadas en el aprendizaje automático para automatizar la creación y distribución de contenido de entretenimiento adulto, o en términos sencillos estamos usando la IA para crear porno. Una gran parte de eso involucra trabajar con tecnologías deepfake y específicamente de cómo introducir personas IA-generadas en videos de manera fotorrealista usando deepfakes.

rekt:

¿Nos puedes contar de tu trabajo en IA antes de fusionarlo con crypto?

EI:

Nuestro equipo tiene más de una década de experiencia en el aprendizaje automático y la visión artificial tras todas las industrias pero primariamente desarrollando soluciones para la agricultura de gran escala y los farmacéuticos.

rekt:

Con relación al video de DeTrade - ¿cuáles fueron tus pensamientos cuando lo viste por primera vez?

EI:

Había mucha especulación acerca de si es “IA-generado” o un deepfake, o los dos. Lo he revisado varias veces ya y aunque es posible que sea un deepfake de una persona real, la persona en el video seguramente no es IA-generada. Creo que es importante entender la diferencia entre estas dos tecnologías.

Nosotros en ELIMINADO hemos entrenado una GAN (red generativa antagónica) para generar nuestras propias personas que no existen. Algo que es fundamentalmente diferente a un ”deepfake”.

rekt:

Por favor, ¿puedes explicar la diferencia entre IA-generado y deepfake?

EI:

Bueno, para ser claro, las tecnologías deepfake si utilizan la IA. Sin embargo, los deepfakes como una tecnología no suponen entrenar una IA para crear una nueva persona. En su lugar, los deepfakes toman un conjunto de datos del rostro de una persona, y lo colocan encima de la cara de otra en un video que ya existe. Si se hizo bien, lo que resulta debe de ser un cambio de cara fotorrealista y convincente en el que tienes a una persona haciendo algo que realmente no hizo. Así que, en suma, los deepfakes no crean una nueva persona en absoluto, más bien se tratan de colocar un rostro que ya existe en un video distinto.

Por el otro lado, para una “persona IA-generada”, si la persona se representa como un video o una imagen fija, implica un tipo de aprendizaje automático totalmente separado en el que se le presenta a la IA (normalmente una GAN) una gran cantidad de datos que contienen fotos de personas distintas para que la IA empiece a entender que es una “persona” o un “cuerpo”. Una vez que se hayan ingresado suficientes datos, la IA puede generar nuevas iteraciones de gente basadas en los datos que ya ha visto. Entonces, este tipo de IA es justo lo opuesto de los deepfakes en términos de nuestra conversación actual, no se puede usar para insertar una persona a un video, pero si puede crear nuevas personas de la nada.

Lo que vi con respecto a DeTrade fueron acusaciones de que la persona en el video fue IA-generada, y que posiblemente se le hizo un deepfake encima de un video existente de otra persona. Quiero que quede claro que esto seguramente no es el caso.

rekt:

¿Qué te hace estar tan seguro?

EI:

Es una cuestión de capacidades. Hay tal vez 5 empresas en el mundo que pueden generar una nueva persona fotorrealista de la nada con una IA y que luego pueden insertar a la persona en un video existente como el que vimos, con este grado de realismo. Yo lo sé bien porque somos una de estas empresas. Las otras son todas empresas tecnológicas multibillonarias como Nvidia, o IA startups de alta reputación con decenas de millones de dólares de financiamiento. La probabilidad que los ejecutivos del c-suite de Nvidia se estén tomando el tiempo de estafar a la comunidad DeFi para un par de millones me parece muy pequeña.

Para ser claro en este punto, hay muchísima gente que pudo haber tomado la cara que viste en el video desde un video de una persona real. Tal vez un profesor dando una clase por zoom o algo.

Pero la idea de que es un rostro IA-generado es casi imposible.

rekt:

Parece que la IA y los deepfakes son las herramientas perfectas para aumentar la paranoia, y muchos van a pensar que van a causar más daño que bien, ¿cómo responderías a esto?

EI:

Yo creo, hablando francamente, que es apropiado ser paranoico.

Creo que todos se tienen que acostumbrar a la idea que solo porque has visto una foto, o un video, o un audio de una persona, no necesariamente significa que aquella persona fue la que apareció en el video, o incluso que la persona realmente exista.

Mucha gente entiende este concepto intelectualmente, pero al mismo tiempo buscan cosas como “equipos no anónimos”, como si ver a un tipo dar un livestream o mostrar una foto de él con su identificación les dé alguna otra capa de protección en su inversión. Eso no es realmente el caso.

Ahora mismo hay muy pocos sitios en donde alguien puede crear una nueva persona de la nada y hacer un video de ella. Estoy orgulloso de contar a nuestra empresa como uno de estos sitios. Pero con el tiempo, estas tecnologías siempre se convierten en más y más fácil de replicar por parte de los entusiastas amateurs o hasta por los estafadores organizados, y rápidamente estamos llegando a ese punto.

Es tan sencillo como tomar en cuenta el hecho de que sin conocer a alguien cara a cara, nunca vas a poder saber si es real, o si el video que viste en que hizo algo realmente fue esa persona o una falsificación. En mi opinión ya estamos en este punto, y la proliferación de esta tecnología vuelve una garantía que mantener este tipo de filosofía será aún más importante a medida que pase el tiempo.

Si no le has dado la mano, no puedes asegurar que alguien existe. Y si no sostuviste su identificación, tampoco puedes estar seguro de que ésta exista.

En la era informática, en la que tanto dependemos de la precisión de los medios, ya no podemos confiar en lo que vemos ni escuchamos.

La innovación siempre ha tenido sus enemigos; ¿cambiarán nuestras opiniones de esta tecnología con el tiempo?

Tal vez en veinte años, nos daremos cuenta que nuestra aversión a los deepfakes fue simplemente un caso de tecnofobia, y que el bien societal sopesa el mal. Con la cobertura que recibe la tecnología actualmente, este futuro es difícil de imaginar.

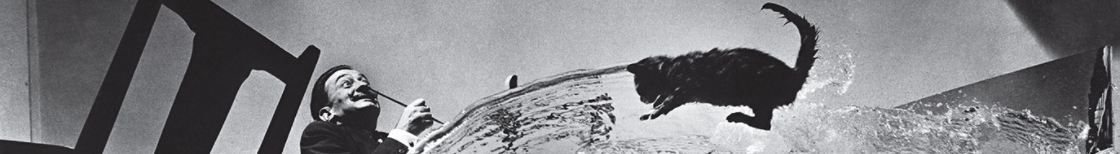

Salvador Dalí una vez dijo “Si muero, no muero por todo”.

Treinta años después de su muerte, sus palabras toman un nuevo significado en El Museo Dalí.

<a href="http://www.youtube.com/watch?feature=player_embedded&v=BIDaxl4xqJ4 " target="_blank"><img src="http://img.youtube.com/vi/BIDaxl4xqJ4/0.jpg" alt="IMAGE ALT TEXT HERE" width="240" height="180" border="10" /></a>

REKT sirve como plataforma pública para autores anónimos, nos deslindamos de la responsabilidad por las opiniones y contenidos alojados en REKT.

dona (ETH / ERC20): 0x3C5c2F4bCeC51a36494682f91Dbc6cA7c63B514C

aviso legal:

REKT no es responsable ni culpable de ninguna manera por cualquier Contenido publicado en nuestro Sitio Web o en conexión con nuestros Servicios, sin importar si fueron publicados o causados por Autores ANÓN de nuestro Sitio Web, o por REKT. Aunque determinamos reglas para la conducta y publicaciones de los Autores ANÓN, no controlamos y no somos responsables por cualquier contenido ofensivo, inapropiado, obsceno, ilegal o de cualquier forma objetable, que se pudiera encontrar en nuestro Sitio Web o Servicios. REKT no es responsable por la conducta, en línea o fuera de línea, de cualquier usuario de nuestro Sitio Web o Servicios.

te podría gustar...

The Creeping Line

Adéntrate en el fascinante mundo de La Línea Avanza, donde la implacable búsqueda del avance de la IA erosiona la línea entre humano y máquina. Cuando las identidades y experiencias se convierten en mercancías en un bazar digital de realidades fabricadas, ¿es este el precio del progreso?

Compounder Finance - REKT

La Parca rekt tiene sus métodos para hacer a la gente hablar. En los últimos momentos, cuando todo el TVL se ha ido, y el drawdown se vuelve inaguantable, una figura sin rostro entra al chat… Sigue a nuestro autor anónimo mientras rastrea e interroga al perpetrador del rug pull de $12M de Compounder Finance.